Alessandro Rudi (Inria Paris et École normale supérieure) a reçu une bourse ERC Starting Grant de 1,5 million d'euros valable pour une durée de cinq ans afin de constituer une nouvelle équipe au sein de l'équipe Sierra d'Inria.

Son objectif ? Faire évoluer l'apprentissage machine (AM) et le rendre à la fois plus fiable et plus rapide.

L'AM est devenu un outil fondamental pour analyser de grandes quantités de données à partir desquelles "prédire" des événements futurs : grâce aux outils de calcul, les programmes d'apprentissage sont capables d'affiner une loi mathématique donnée qui correspond à un ensemble de données étiquetées (données d'apprentissage) et de traiter ensuite de nouvelles données pour offrir un aperçu saisissant de leur évolution et/ou de leur répartition. Il apparaît alors évident que plus un algorithme reçoit de données d'apprentissage, plus il sera "préparé" à prédire une nouvelle donnée.

Les outils basés sur l’AM ont atteint un point de blocage

On se souvient tous que l’AM a publiquement démontré sa capacité à apprendre à jouer au go ou aux échecs et à gagner contre des humains. Mais ce genre de victoire retentissante repose sur des ressources de calcul et un temps d'apprentissage énormes, dont le coût se chiffre en millions d'euros par jour. Si les algorithmes d'AM sont aujourd'hui des éléments de base essentiels dans les systèmes complexes utilisés dans les domaines de la prise de décision, de l'ingénierie et de la science, les outils de l’AM ordinaires sont soit très coûteux, soit pas fiables à 100 %, en raison de la façon dont l'étape d'apprentissage se déroule. Les données d'apprentissage contiennent généralement beaucoup de bruit et il faut un grand nombre de ces données car, statistiquement, la précision augmente comme la racine carrée de n, où n est le nombre de données. Pour surmonter les problèmes de calcul, les méthodes actuelles font un compromis entre la précision des prévisions et l'efficacité de la procédure, mais les prévisions correspondantes ne sont généralement pas assorties de garanties de validité.

Cependant, l'impact des résultats de l'AM a augmenté ces dix dernières années et les algorithmes d'apprentissage machine sont largement utilisés malgré deux principales lacunes : ils ne sont pas suffisamment rentables – ce qui a un impact direct sur les coûts économiques/énergétiques de l'AM à grande échelle et fait que les universités ou les instituts de recherche peuvent à peine se les permettre – et les prévisions manquent de fiabilité, ce qui nuit fortement à la sécurité des systèmes où l'AM est utilisé. Les outils basés sur l'AM ont en effet atteint un point de blocage : la quantité de données augmente beaucoup plus vite que les ressources de calcul (ère post loi de Moore*) et les algorithmes sont en fait comme des "boîtes noires" à partir desquelles on peut avoir une réponse tout en ignorant si elle est fiable... De plus, l'AM ne peut pas être appliqué à des domaines dans lesquels les données peuvent être rares comme l'analyse scientifique.

Réinventer l'apprentissage machine

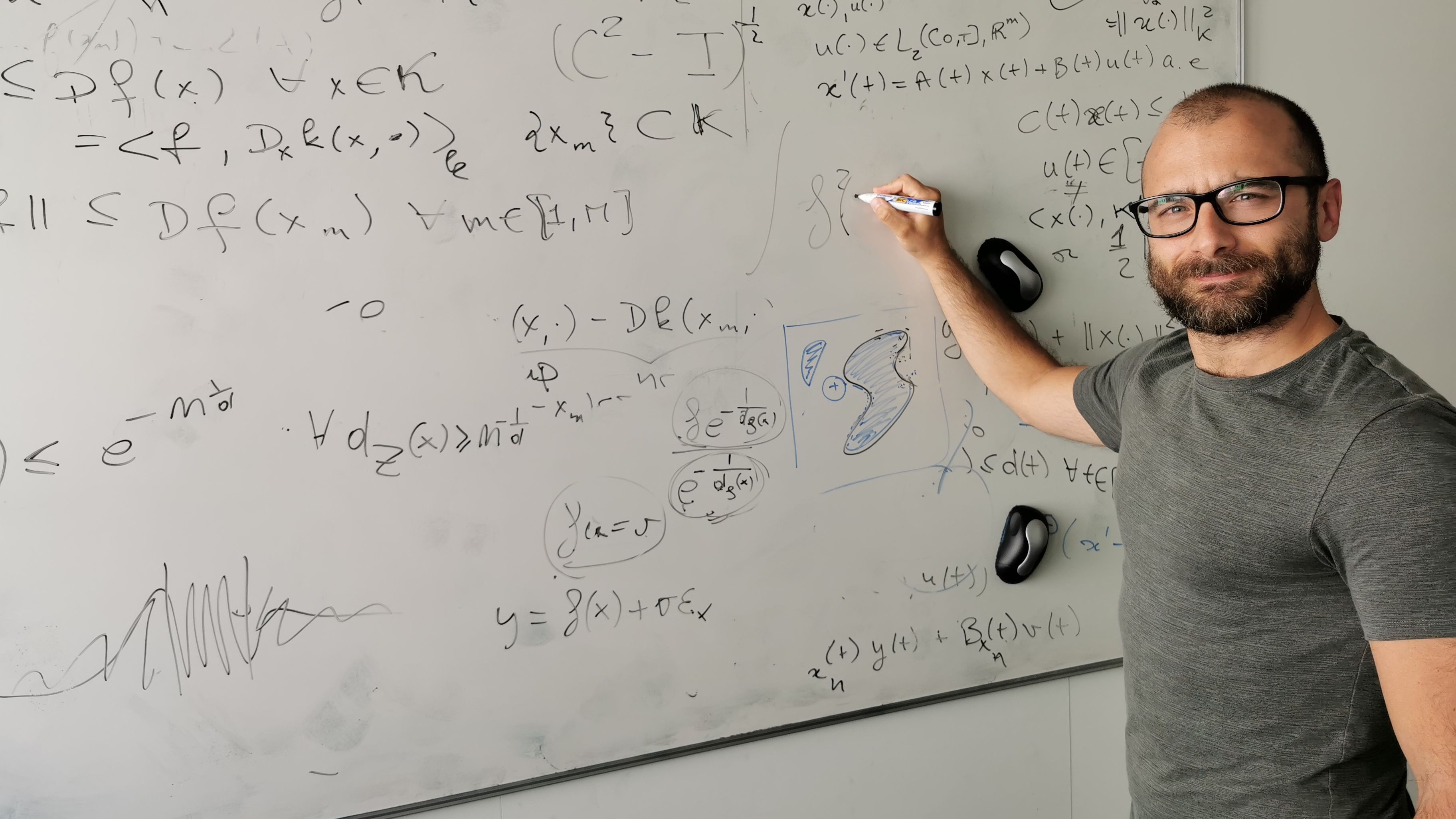

Pour faire face à ces problèmes, Alessandro Rudi a reçu une bourse ERC Starting Grant pour travailler au sein de l'équipe Sierra et relever ce grand défi. Ses recherches à Inria sur "l'apprentissage machine à grande échelle, efficace et structuré avec des garanties statistiques" ouvrent la voie à une nouvelle ère en matière d'AM (encadré 2). Il a déjà démontré son expertise dans le domaine des algorithmes d'apprentissage machine précis et rentables, validés par la théorie au travers de nombreux articles examinés par des pairs et publiés dans les plus importantes revues et conférences internationales du domaine, comme NeurIPS, et FALKON une solide bibliothèque en Python pour les architectures multiprocesseurs graphiques, capable de traiter sur des postes de travail standard des ensembles de données de milliards d'exemples en quelques minutes.

Grâce à cette bourse ERC Starting Grant, il s'entourera dans la nouvelle équipe appelée REAL, d'un ingénieur, de deux postdoctorants et de quatre doctorants, pour fournir un cadre théorique et algorithmique solide pour un apprentissage machine à grande échelle fiable et rentable sur des architectures de calcul modernes.

Son objectif est de changer la façon même dont les algorithmes d'AM sont construits et d'utiliser les mathématiques fondamentales pour fournir des modèles d'apprentissage plus efficaces et plus fiables. Il est en effet possible de réduire mathématiquement le nombre de paramètres qui méritent d'être conservés pour la même précision et d'utiliser des modèles avec moins de paramètres mais la même précision. Il est alors possible de calculer avec précision l'incertitude des résultats fournis par les algorithmes – c'est-à-dire d'obtenir des prévisions assorties de limites explicites quant à leur degré d'incertitude garanti par la théorie. De plus, ces algorithmes s'adapteront naturellement aux nouvelles architectures et atteindront de manière prouvée le niveau de fiabilité et de précision souhaité en utilisant le moins de ressources de calcul possible. À l'heure actuelle, les premiers résultats leur permettent, sur un simple ordinateur portable, de traiter 109 données, ce qui nécessite mille ordinateurs pour les algorithmes d'AM ordinaires. La manière dont le fonds sera utilisé apparaît donc évidente : « embaucher et limiter l’achat d’ordinateurs ! ».

Grâce à cette bourse ERC Starting Grant, Alessandro Rudi pourra développer des méthodes et des techniques qui aideront l'apprentissage machine à devenir un outil sûr, efficace et fondamental en science et en ingénierie pour traiter des problèmes de données à grande échelle. Les algorithmes générés par REAL seront publiés sous forme de bibliothèques open source pour des configurations distribuées et multiprocesseurs graphiques. Leur efficacité sera largement testée sur des critères clés de la vision par ordinateur, du traitement du langage naturel, du traitement audio et de la bio-informatique.

*La loi de Moore (1975) prévoyait un doublement tous les deux ans du nombre de composants par circuit intégré (et donc des capacités de calcul). Cependant, depuis les années 2010, les progrès en matière de semi-conducteurs ont ralenti en dessous du rythme prévu par la loi de Moore.

Dates clés du parcours d’Alessandro Rudi

- Avril 2014 • Doctorat : « Apprentissage machine à grande échelle avec garanties statistiques »

- Italian Institute of Technology, Université de Gênes

- 2014-2016 • Post-doctorat : « Apprentissage machine statistique à grande échelle, rapide et d'une précision éprouvée »

- 2017 • Postdoctorat : « Méthodes à noyau rapide pour les données à grande échelle, avec garanties statistiques »

- LCSL / MIT / Université de Gênes (Italie) / IIT.

- Sept • 2017 : Chercheur / équipe Sierra

- Inria Paris & École normale supérieure (ENS).

- Sept • 2020 : Bourse ERC Starting Grant REAL

Les sujets qui ouvrent la voie à l'équipe REAL

La mission de REAL s'articule autour de cinq grands défis :

- Théorie. Définir des limites statistiques et de calcul strictes pour obtenir les plus grandes précision et fiabilité possible dans l'apprentissage supervisé avec des données à grande échelle. Caractériser les compromis qui en résultent.

- Algorithmes. Concevoir des algorithmes, assortis d'une limite explicite à l'incertitude, qui mettent à profit les compromis pour atteindre de manière prouvée une précision et une fiabilité maximales avec des coûts de calcul minimaux.

- Architectures. Ajuster les algorithmes résultants pour qu'ils s'adaptent naturellement aux architectures hétérogènes distribuées et aux équipements haute performance de faible précision (comme les systèmes multiprocesseurs graphiques), tout en conservant les propriétés d'optimalité.

- Problèmes structurés. Généraliser les algorithmes pour exploiter la structure intrinsèque du problème.

- Déploiement. Mise à disposition de bibliothèques utilisables en open source, prouver leur efficacité sur des critères clés.

Pour en savoir plus...

- Une vidéo (FR) : « Intelligence artificielle par apprentissage automatique », Francis Bach (directeur de l’équipe-projet Sierra), École des hautes études en sciences sociales (EHESS), septembre 2019.

► Voir la vidéo

- Pour comprendre l'apprentissage machine : « Le machine learning expliqué par Stéphan Clémençon, chercheur à Télécom ParisTech », I’MTech, octobre 2014.

► Lire

- Une application récente de l'apprentissage machine : « Microscope : l’outil développé par OpenAI pour comprendre le fonctionnement des algorithmes », Valentin Cimino, Le Siècle digital, avril 2020.

► Lire l'article