Dans le cadre de ses recherches doctorales chez Inria et à l'École polytechnique de Paris, ainsi qu'à l'Université Macquarie de Sydney, en Australie, Natasha Fernandes a réalisé cette extension et introduit une nouvelle méthode plus transparente pour évaluer les risques liés à la confidentialité. Preuve de l’importance de ses travaux, Natasha Fernandes a reçu le 13 octobre 2021 le prix « John Makepeace Bennett » (CORE) pour la meilleure thèse en informatique.

Confidentialité versus utilité

Introduite pour la première fois par des chercheurs aux États-Unis en 2006 (Dwork et al), la confidentialité différentielle s'appuie sur les recherches des statisticiens du XXe siècle qui visaient à garantir la confidentialité des informations privées lors de la publication de données issues d'une base de données statistiques, comme les recensements. Toute publication de données de ce type doit trouver un équilibre entre l'utilité des données et la confidentialité des personnes qui les fournissent. En ajoutant aux données un « bruit » statistique généré par des données aléatoires en fonction de leur niveau de sensibilité, la confidentialité différentielle vise à garantir que les pirates ne pourront pas obtenir plus d'informations sur les fournisseurs de données qu'ils n'en ont déjà. Ainsi, l'utilité et la confidentialité sont toutes deux satisfaites, et davantage de personnes sont susceptibles d'accepter de participer à des bases de données statistiques.

Pour y parvenir, le conservateur de la base de données doit appliquer le bon chiffre, ou la bonne quantité de « bruit », à l'équation différentielle de confidentialité, en fonction de son évaluation du risque d'atteinte à la vie privée. Ce principe apparemment simple est plus complexe dans la pratique. « Même un expert peut avoir du mal à savoir si la façon dont il a appliqué la confidentialité différentielle sera efficace, car dans sa forme actuelle, son mécanisme est trop mathématique pour être facile à expliquer, » commente Natasha Fernandes, associée de recherche à l’UNSW Canberra. « Lorsqu'un médecin dit à un patient qu'il a besoin d'une intervention chirurgicale, il l'informe également des risques encourus, mais nous n'avons pas de moyen simple d'expliquer les risques en matière de confidentialité des données. C'était l'un des problèmes que je voulais résoudre dans mes recherches doctorales. »

La confidentialité différentielle locale, une nouvelle orientation majeure

Elle visait également à étendre la confidentialité différentielle afin qu'elle puisse être appliquée à des ensembles de données modernes tels que des documents textuels de manière significative et interprétable. Avec Catuscia Palamidessi, directrice de recherche chez Inria et à l’Institut Polytechnique de Paris, et Annabelle Mciver, professeure à l’Université Macquarie de Sydney, comme co-superviseurs (voir encadré), Natasha Fernandes a pu s'appuyer sur leurs travaux sur la confidentialité différentielle locale, où le « bruit » est appliqué aux données fournies par un seul utilisateur plutôt qu'aux résultats d'une requête sur une base de données dans son ensemble. « La confidentialité différentielle locale est une nouvelle direction majeure en matière de confidentialité qui est de plus en plus utilisée par des géants comme Google ou Apple, » explique Catuscia Palamidessi. « Notre travail l'a rendue traitable dans les domaines de données métriques en prenant en compte la distance entre les données dans la formule de confidentialité différentielle, de sorte qu'elle offre beaucoup plus d'utilité pour le même degré de confidentialité. »

Verbatim

La confidentialité différentielle locale est une nouvelle direction majeure en matière de confidentialité qui est de plus en plus utilisée par des géants comme Google ou Apple.

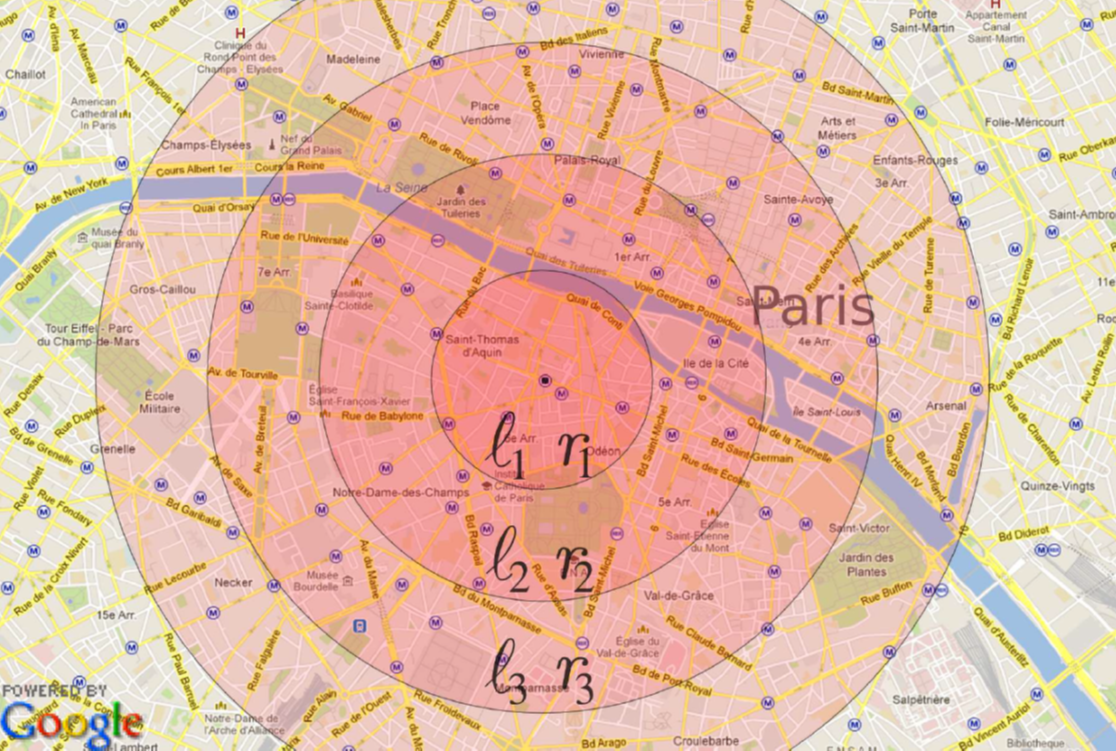

Directrice de recherche Inria

Catuscia Palamidessi et ses partenaires du CNRS et de l’École polytechnique ont déjà appliqué leurs travaux à Location Guard. Cette application de navigation, disponible sur des plateformes telles que Chrome, Firefox et Opera, permet à ses plus de 200 000 utilisateurs de masquer leur emplacement exact. Par exemple, un touriste à Paris pourrait ne pas vouloir révéler qu'il visite le cabaret du Moulin Rouge, aussi, l'application le localisera dans une zone plus large, incluant par exemple la cathédrale Notre-Dame ou le Louvre.

Cacher les styles d'écriture

Les travaux de Natasha Fernandes ont poussé un peu plus loin la confidentialité différentielle locale avec des métriques en l'appliquant aux documents texte de telle manière qu'un ordinateur puisse comprendre de quoi parle le texte sans pouvoir identifier son auteur. « La littérature suggérait qu'il était impossible d'appliquer la confidentialité différentielle aux textes, ce qui m'a rendue encore plus déterminée ! » se souvient Natasha Fernandes. « Pour garantir que l'apprentissage automatique ne puisse pas détecter le style d'écriture d'un auteur donné, nous avons ajouté une mesure de distance et montré mathématiquement qu'il était possible de conserver la classification du document tout en se protégeant contre l'identification. »

Cette extension a de nombreuses applications potentielles : un lanceur d'alerte serait capable de révéler des informations tout en restant anonyme, par exemple, une agence de renseignement pourrait protéger des informations classifiées lors de la publication de documents sensibles, ou un détaillant pourrait analyser les courriels des consommateurs sans savoir qui ils sont. « La confidentialité suscite actuellement un grand intérêt et, parce qu’elle a été la première à appliquer avec succès la confidentialité différentielle locale aux ensembles de données textuelles, les travaux de Natasha ont aidé à résoudre un problème très complexe », explique Annabelle McIver. À tel point qu'ils ont suscité l'intérêt d’Amazon, où les chercheurs l'ont repris et organisent désormais des ateliers semestriels sur la confidentialité des textes, à la suite des recherches originales de Natasha Fernandes.

Verbatim

L’explication est cruciale pour que les mécanismes de confidentialité fassent le travail qu'ils sont censés faire, et les recherches de Natasha constituent un grand pas en avant sur cette voie.

Professeure à l’Université Macquarie de Sydney

Prouver l'utilité des mécanismes de confidentialité

Ses travaux ont également permis de mieux comprendre l'une des techniques fondamentales pour l'application de la confidentialité différentielle, le mécanisme de Laplace, qui est un moyen simple et efficace d'ajouter du « bruit » pour préserver la confidentialité, et qui peut être réglé pour fournir le niveau de confidentialité souhaité. La recherche de 2006 (Dwork et al) a conçu la confidentialité différentielle autour de Laplace, mais bien que ce mécanisme fondamental soit couramment utilisé pour protéger la confidentialité, peu de recherches ont été menées pour savoir s'il était réellement utile. « Laplace est crucial car il s'agit d'un élément fondamental de la confidentialité différentielle », explique Natasha Fernandes, « et mes travaux ont confirmé qu'il fournit réellement une « optimalité universelle », c'est-à-dire la plus grande précision de tous les mécanismes de confidentialité pour la plus grande variété de consommateurs. »

Ses recherches ont également révélé que d'autres mécanismes de confidentialité, actuellement utilisés par Google, sont également optimaux dans certaines situations, infirmant un résultat d'impossibilité selon lequel ce ne pouvait être le cas.

Verbatim

À l'avenir, cela pourrait déboucher sur un moyen d'illustrer les risques en ajoutant un graphique aux formulaires de consentement en ligne ou en donnant aux consommateurs la possibilité de définir leurs propres paramètres.

Ancienne doctorante, associée de recherche à l’UNSW Canberra

Comprendre les risques

Cette confirmation est une étape importante pour permettre à Natasha Fernandes d'atteindre l'un de ses principaux objectifs : faciliter la compréhension des risques de violation de la vie privée. « Si les gens ont besoin d'un diplôme en mathématiques pour comprendre le degré de risque d'une atteinte à la vie privée, cela ne leur inspire pas la confiance nécessaire pour se sentir assez à l'aise pour partager leurs données, » explique Annabelle McIver. « L’explication est cruciale pour que les mécanismes de confidentialité fassent le travail qu'ils sont censés faire, et les recherches de Natasha constituent un grand pas en avant sur cette voie. »

Ses travaux ont fourni un cadre permettant de décrire tous les types d'attaques et de montrer quels mécanismes protègent contre quels types d'attaques. « Aujourd'hui, il est difficile pour les consommateurs de comprendre si on leur dit qu'un mécanisme de protection de la confidentialité a été paramétré par 3 ou 4, par exemple, mais si je peux demander quel type d'attaque les inquiète, je peux le modéliser et leur dire quelle est la probabilité que leur secret soit révélé, » explique Natasha Fernandes. « À l'avenir, cela pourrait déboucher sur un moyen d'illustrer les risques en ajoutant un graphique aux formulaires de consentement en ligne ou en donnant aux consommateurs la possibilité de définir leurs propres paramètres. » Et elle conclut : « J’espère que mes recherches finiront par permettre aux consommateurs de comparer facilement les systèmes de confidentialité et de faire un choix clair et éclairé. »

Les avantages de la co-supervision

Catuscia Palamidessi et Annabelle McIver travaillent ensemble depuis plusieurs années et leur collaboration a été l'occasion pour Natasha Fernandes de bénéficier d'une expertise dans deux domaines et sur deux continents. La co-supervision est assez courante en France, mais plus rare en Australie et Natasha Fernandes a été la première doctorante de l'Université Macquarie à travailler de cette manière chez Inria et au sein de l'École polytechnique. Elle a passé 15 mois sur le campus de Paris avant de retourner à Sydney pour terminer ses recherches. « L’environnement de recherche australien a tendance à être assez isolé et mon séjour en Europe m'a donné une vision totalement différente de la façon dont la science y est menée, » explique-t-elle. « Et comme mes recherches couvraient plusieurs domaines différents, c'était aussi un vrai plus d'être supervisée par deux experts de premier plan. »

Ses co-superviseurs sont d’accord avec elle. « D'un point de vue scientifique, différentes personnes ont des compétences différentes, et Annabelle et moi sommes très complémentaires, puisque mon travail concerne la confidentialité et le sien les méthodes formelles, » commente Catuscia Palamidessi. Et Annabelle McIver d’ajouter : « De nombreuses recherches sont en cours en Europe sur la confidentialité différentielle, c'était donc une merveilleuse occasion pour Natasha de rencontrer de nombreux scientifiques et d'interagir avec eux. Et bien sûr, le fait de pouvoir travailler en étroite collaboration avec elle et Catuscia a été formidable ! »

En savoir plus

- Articles publiés par Natasha Fernandes : https://dblp.org/pid/220/4193.html

- Une conférence d'Annabelle McIver sur le travail de Natasha Fernandes lors d'un atelier Amazon sur le traitement du langage naturel : https://slideslive.com/38939778/nlp-and-differential-privacy-with-metrics